onprem.ai für KMUs Lokale KI-Infrastruktur für sichere und kontrollierte Anwendungen

Sofort einsatzbereit, kosten-transparent und benutzerfreundlich. Für den direkten Einsatz im Büro oder als Schnittstelle für eigene KI-Projekte mit schützenswerten Daten. Souveräne KI, in der Schweiz entwickelt, von unabhängigen KI-Experten mit langjähriger Praxiserfahrung im Business-Bereich.

Sofort Einsatzbereit

Enterprise KI Server mit vorkonfiguriertem Chat und APIs

Für den professionellen Soforteinsatz. Leistungsstarke Hardware und nahtlos skalierbare Software auf Rechenzentrumsniveau. Einzeln oder im Verbund als Cluster einsetzbar.

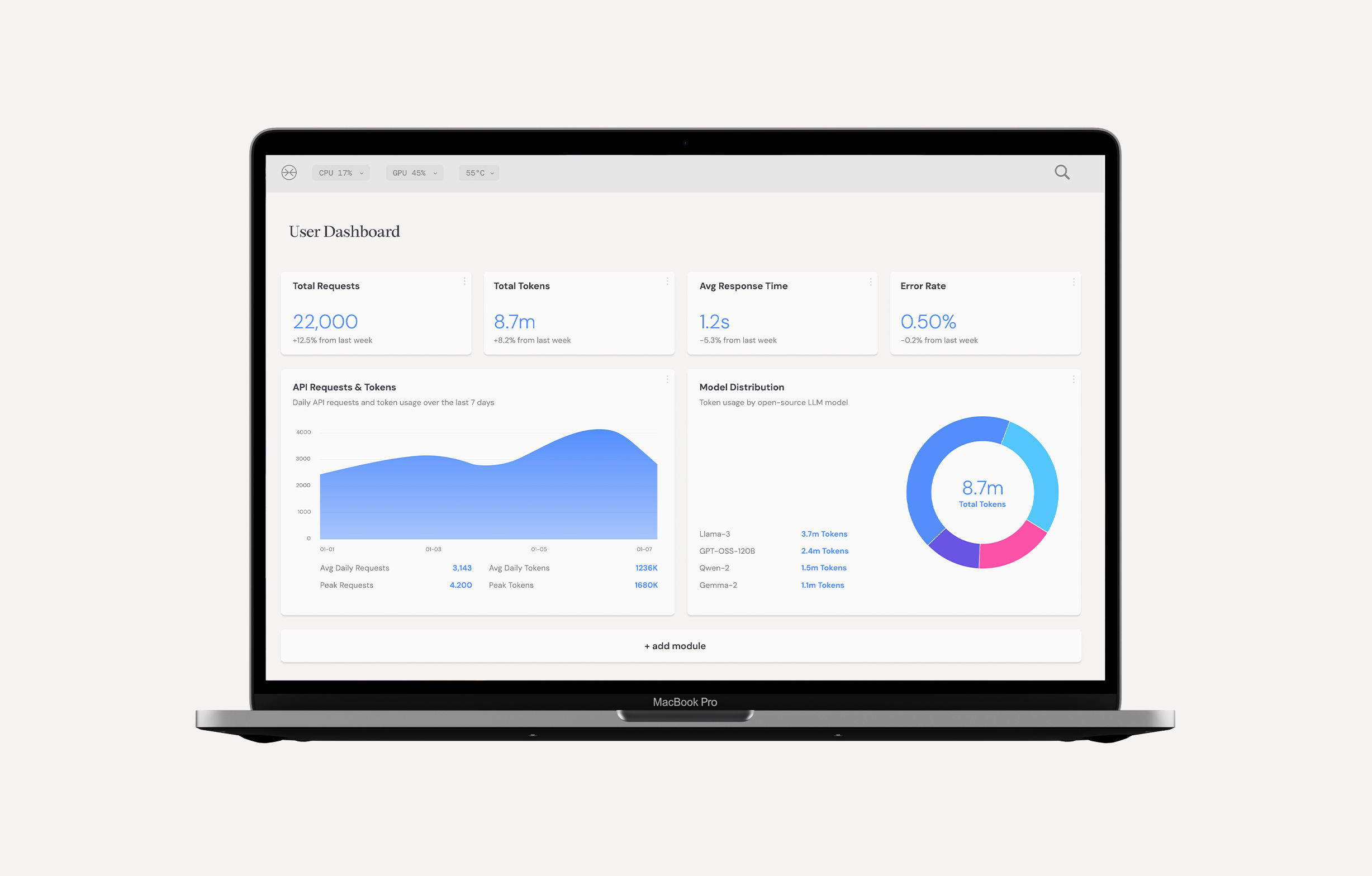

Keine Blackbox

Benutzerfreundliches Ressourcen-Management und Monitoring

Einfache, zentrale Oberfläche

Eine einheitliche Console bündelt Projekte, Modelle, Cluster-Steuerung und Auslastung in einer klar strukturierten, benutzerfreundlichen Ansicht.

Transparenz und Sicherheit

Integriertes Monitoring mit Echtzeit-Metriken zu Auslastung, kombiniert mit Audit-Logs für nachvollziehbare Nutzung.

Intelligente Ressourcenverteilung

Smartes Load Balancing und richtlinienbasierte Compute-Steuerung und stellen sicher, dass geschäftskritische Workloads priorisiert laufen, während weniger dringende Aufgaben automatisch in freie Kapazitäten verschoben werden.

Multi-Tenancy & Governance

Eine klare Trennung von Mandanten mit eigenen Quotas und isolierten Arbeitsbereichen ermöglicht es, mehrere Geschäftsbereiche sicher auf derselben Infrastruktur zu betreiben.

Automatische Cluster

Dank Auto-Discovery werden neue KI Server automatisch erkannt und können ganz einfach in passende Cluster- oder Ressourcengruppen eingebunden werden. So wächst die Infrastruktur dynamisch mit.

Agent

Vorne mit dabei, ohne Datenabfluss in die Cloud

Datenschutz, ganz einfach

Statt nur zu chatten, erledigt die KI Aufgaben für Sie: Sie fragt Ihre internen Datenquellen ab, stößt Prozesse an und erstellt Ergebnisse direkt in Ihren Systemen. Alles über natürliche Sprache, vollständig on-premise – Ihre Daten verlassen niemals Ihre Infrastruktur. Wir helfen gerne bei der Integration.

Services ansehenVielseitig

Einfache Integration in Eigene KI-Projekte: Von Devs für Devs entwickelt

APIs und MCPs

Effizient für Entwickler

Standardisierte Schnittstellen erlauben eine effiziente Anbindung der onprem KI in bestehende Fachapplikationen. LLM APIs und Model Context Protocol (MCPs) sind auf den onprem KI Servern vorinstalliert und sofort einsatzbereit, mit entwicklerfreundlichen Werkzeugen und Monitoring.

Container und eigene KIs

Völlige Flexibilität

Eigens trainierte KI Modelle trainieren können in allen gängigen Formaten (GGUF, ONNX, PyTorch, TensorRT) auf dem onprem KI server betrieben werden. Im Container-Format mit GPU Zugriff (Kubernetes HEML, Docker Compose) können selbst die komplexesten KIs für Video, Audio oder Bild installiert werden.

Workflow Automation

No Code / Low Code

Über eine visuelle Oberfläche können Geschäftsprozesse ganz ohne Programmierkenntnisse automatisiert werden. Durch das Verbinden von Datenquellen und Arbeitsschritten per Drag-and-Drop entstehen wiederverwendbare Abläufe, die Routineaufgaben spürbar entlasten.

Kosten-Transparent

Sicherheit, auch in Ihrer Budget-Planung

Alle Preise zzgl. MwSt

Fragen?

Wir helfen gerne.

Unser Team unterstützt Sie gerne persönlich bei technischen Fragen, Angeboten oder individuellen Anforderungen. Viele Fragen beantworten wir bereits in unseren häufig gestellten Fragen – klar, kompakt und praxisnah.

%20--%3e%3c!DOCTYPE%20svg%20PUBLIC%20'-//W3C//DTD%20SVG%201.1//EN'%20'http://www.w3.org/Graphics/SVG/1.1/DTD/svg11.dtd'%3e%3csvg%20version='1.1'%20id='svg2'%20xmlns:svg='http://www.w3.org/2000/svg'%20xmlns='http://www.w3.org/2000/svg'%20xmlns:xlink='http://www.w3.org/1999/xlink'%20x='0px'%20y='0px'%20width='351.46px'%20height='258.785px'%20viewBox='35.188%2031.512%20351.46%20258.785'%20enable-background='new%2035.188%2031.512%20351.46%20258.785'%20xml:space='preserve'%3e%3ctitle%20id='title4'%3egenerated%20by%20pstoedit%20version:3.44%20from%20NVBadge_2D.eps%3c/title%3e%3cpath%20id='path17'%20d='M384.195,282.109c0,3.771-2.769,6.302-6.047,6.302v-0.023c-3.371,0.023-6.089-2.508-6.089-6.278%20c0-3.769,2.718-6.293,6.089-6.293C381.427,275.816,384.195,278.34,384.195,282.109z%20M386.648,282.109c0-5.175-4.02-8.179-8.5-8.179%20c-4.511,0-8.531,3.004-8.531,8.179c0,5.172,4.021,8.188,8.531,8.188C382.629,290.297,386.648,287.281,386.648,282.109%20M376.738,282.801h0.91l2.109,3.703h2.316l-2.336-3.859c1.207-0.086,2.2-0.661,2.2-2.286c0-2.019-1.392-2.668-3.75-2.668h-3.411%20v8.813h1.961V282.801%20M376.738,281.309v-2.122h1.364c0.742,0,1.753,0.06,1.753,0.965c0,0.985-0.523,1.157-1.398,1.157H376.738'/%3e%3cpath%20id='path19'%20d='M329.406,237.027l10.598,28.993H318.48L329.406,237.027z%20M318.056,225.738l-24.423,61.88h17.246l3.863-10.934%20h28.903l3.656,10.934h18.722l-24.605-61.888L318.056,225.738z%20M269.023,287.641h17.497v-61.922l-17.5-0.004L269.023,287.641z%20M147.556,225.715l-14.598,49.078l-13.984-49.074l-18.879-0.004l19.972,61.926h25.207l20.133-61.926H147.556z%20M218.281,239.199h7.52%20c10.91,0,17.966,4.898,17.966,17.609c0,12.714-7.056,17.613-17.966,17.613h-7.52V239.199z%20M200.931,225.715v61.926h28.366%20c15.113,0,20.048-2.512,25.384-8.148c3.769-3.957,6.207-12.641,6.207-22.134c0-8.707-2.063-16.468-5.66-21.304%20c-6.481-8.649-15.817-10.34-29.75-10.34H200.931z%20M35.188,225.629v62.012h17.645v-47.086l13.672,0.004%20c4.527,0,7.754,1.128,9.934,3.457c2.765,2.945,3.894,7.699,3.894,16.395v27.23h17.098v-34.262c0-24.453-15.586-27.75-30.836-27.75%20H35.188z%20M172.771,225.715l0.007,61.926h17.489v-61.926H172.771z'/%3e%3cpath%20id='path21'%20fill='%2377B900'%20d='M82.211,102.414c0,0,22.504-33.203,67.437-36.638V53.73%20c-49.769,3.997-92.867,46.149-92.867,46.149s24.41,70.565,92.867,77.026v-12.804C99.411,157.781,82.211,102.414,82.211,102.414z%20M149.648,138.637v11.726c-37.968-6.769-48.507-46.237-48.507-46.237s18.23-20.195,48.507-23.47v12.867%20c-0.023,0-0.039-0.007-0.058-0.007c-15.891-1.907-28.305,12.938-28.305,12.938S128.243,131.445,149.648,138.637%20M149.648,31.512%20V53.73c1.461-0.112,2.922-0.207,4.391-0.257c56.582-1.907,93.449,46.406,93.449,46.406s-42.343,51.488-86.457,51.488%20c-4.043,0-7.828-0.375-11.383-1.005v13.739c3.04,0.386,6.192,0.613,9.481,0.613c41.051,0,70.738-20.965,99.484-45.778%20c4.766,3.817,24.278,13.103,28.289,17.168c-27.332,22.883-91.031,41.329-127.144,41.329c-3.481,0-6.824-0.211-10.11-0.528v19.306%20h156.032V31.512H149.648z%20M149.648,80.656V65.777c1.446-0.101,2.903-0.179,4.391-0.226c40.688-1.278,67.382,34.965,67.382,34.965%20s-28.832,40.043-59.746,40.043c-4.449,0-8.438-0.715-12.028-1.922V93.523c15.84,1.914,19.028,8.911,28.551,24.786l21.18-17.859%20c0,0-15.461-20.277-41.524-20.277C155.021,80.172,152.31,80.371,149.648,80.656'/%3e%3c/svg%3e)